Lerneinheit Kapitel 2: KI im Wandel der Zeit

Ein Blick in die Vergangenheit

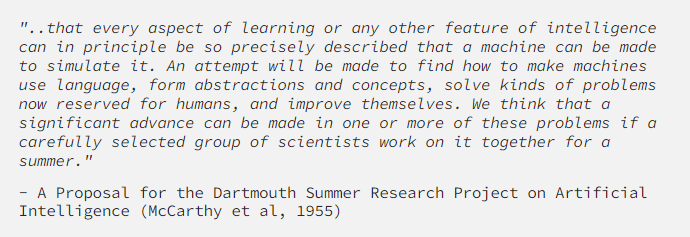

Ein eindeutiger Geburtszeitpunkt der Künstlichen Intelligenz lässt sich nicht bestimmen. Als Entstehungsstunde auf akademischer Ebene gilt die Dartmouth Conference im Sommer 1956 am Dartmouth College in Hanover (New Hampshire). Im Rahmen dieses sechswöchigen Workshops trafen sich Wissenschaftlerinnen und Wissenschaftler verschiedener Disziplinen, um sich über Möglichkeiten darüber auszutauschen, wie Aspekte des Lernens sowie weitere Merkmale menschlicher Intelligenz von Maschinen simuliert werden können. Im Antrag zu diesem Treffen wurde – vorgeschlagen von John McCarthy, dem Organisator des Workshops – erstmals der Begriff Künstliche Intelligenz verwendet.

Die Idee, menschliche Intelligenz oder ganz allgemein die Vorgänge des menschlichen Denkens zu automatisieren oder zu mechanisieren ist allerdings schon sehr viel älter. So gab es bereits Überlegungen, dass der Mensch eine Maschine konstruieren und bauen könnte, die auf irgendeine Art und Weise intelligentes Verhalten zeigt.

Bereits Thomas Hobbes (1588-1679) postulierte die Annahme, dass menschliches Denken symbolisches Schließen sei, also nichts Anderes als einen Sachverhalt mit Papier und Stift herauszuarbeiten (‚Reasoning is nothing but reckoning‘; dt.: Denken ist nichts Anderes als Rechnen).

Nur wenig später konzipierte Gottfried Wilhelm Leibniz (1646-1716) eine Universal-Maschine, die alles ausrechnen kann, also theoretisch in der Lage ist, logische Schlüsse zu ziehen. Leibniz war davon überzeugt, dass Wissen in einer formalen Beschreibungssprache festgehalten und somit auch als Grundlage für die Konzeptionierung von Maschinen genutzt werden kann.

Zudem wird häufig Julien Offray de La Mettrie (1709 – 1751) und sein 1748 veröffentlichtes Werk L’Homme Machine (dt.: Maschine Mensch) als eine der frühen Quellen genannt – durch seine Beschreibung des Menschen als eine sich selbst steuernde biologische Maschine erscheint die künstliche Genese einer solchen Maschine als realistisches Vorhaben.

Veränderung in Wellen:

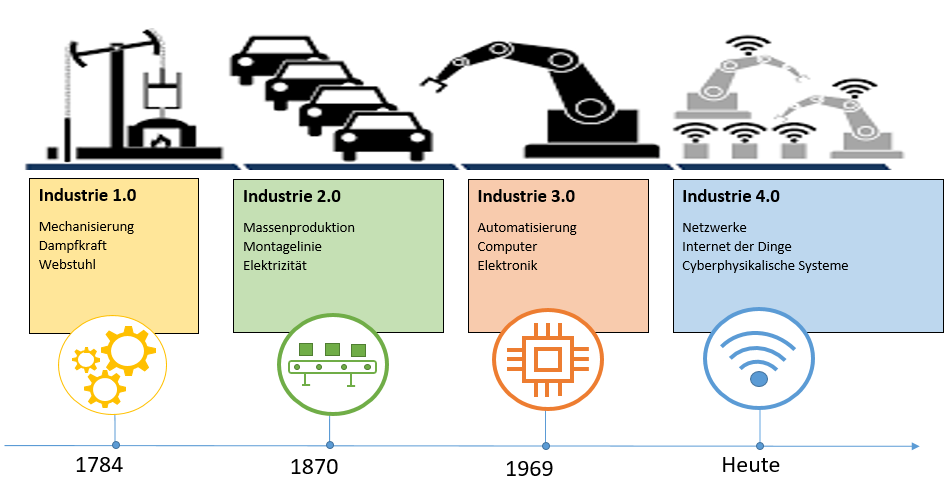

Industrie 1.0 – 4.0

Technische Innovationen wirken sich auch auf die Welt der Arbeit aus – sie können zu einer veränderten Arbeitsteilung zwischen Mensch und Maschine führen und wirken sich grundsätzlich auf Tätigkeitsprofile in verschiedensten Bereichen aus. Künstliche Intelligenz ist dabei nicht die erste technische Entwicklung, die große Wellen nach sich zieht. Zur besseren Einordnung wird im Folgenden ein kurzer Überblick über die Historie der letzten vier industriellen Revolutionen gegeben.

Die erste industrielle Revolution begann im 18. Jahrhundert als durch die Nutzung der Dampfkraft erstmalig die maschinelle Produktion von Gütern und Dienstleistungen ermöglicht wurde. Dampfkraft war zu diesem Zeitpunkt bereits lange bekannt, der Einsatz im industriellen Kontext konnte jedoch eine erhebliche Steigerung der Produktivität erzielen. Wurden zuvor etwa einfache Spinnräder zur Herstellung von Fäden eingesetzt, schaffte eine mechanisierte Variante das achtfache Volumen in derselben Zeit. Diese Transformation der Arbeitswelt betraf entgegen der gängigen Meinung vor allem hochqualifizierte Arbeiter. Nicht-routinemäßige Aufgaben, die bisher nur von geschulten Handwerkern ausgeführt wurden, konnten durch die Unterstützung von Maschinen von nun an auch von weniger qualifizierten Arbeitern übernommen werden.

Die zweite industrielle Revolution ging mit einer zunehmenden Verfügbarkeit von Elektrizität sowie modernen Kommunikationsmitteln wie Schreibmaschinen und Telefonen Ende des 19. Jahrhunderts einher. Zudem gilt die Einführung der Fließbandarbeit als Meilenstein dieser Entwicklungswelle. Die Fließbandarbeit wurde im Jahr 1913 erstmals durch Henry Ford in der Autoproduktion eingesetzt. Die moderne Industrie war somit geprägt von der Unterteilung der Produktion in einzelne, in sich abgeschlossene Arbeitsschritte statt der Durchführung mehrerer Arbeitsschritte durch einen einzelnen Arbeiter. Ausgeführt wurden diese Teilschritte durch ausschließlich auf die jeweilige Tätigkeit spezialisierte Arbeitskräfte. Die Produktion entwickelte sich hin zur Reihenfertigung. Hierbei werden Maschinen nach der Reihenfolge der Arbeitsschritte angeordnet. So entstanden also komplette Fertigungsstraßen.

In den 1970er Jahren startete die dritte industrielle Revolution. Prägend für diese Phase sind eine flächendeckende Einführung der Informationstechnologie (zum Beispiel Computer) und eine zunehmende Verfügbarkeit des Internets. Erste große Rechenmaschinen und mit ihnen auch die ersten programmierbaren Steuerungen fanden in den 1940er Jahren Einzug in Großunternehmen. Basierend darauf und auf standardisierten Geschäftsprozessen dehnte sich Automatisierungstechnik neben mechanischen Aufgaben auch auf kognitive Routineaufgaben in Büros und Verwaltungen aus. Kennzeichnend für Industrie 3.0 ist eine sukzessive (Teil-)Automatisierung von Arbeitsschritten, wobei menschliche Arbeitskraft zunehmend durch Maschinen in der Reihenfertigung ersetzt wird. Dadurch wurde die Sorge vor Arbeitsplatzverlusten und einer Verdrängung von Menschen auf dem Arbeitsmarkt in verschiedenen Branchen angefacht.

Das Ende des 20. Jahrhunderts gilt als der Beginn der vierten industriellen Revolution. Kennzeichnend für die Industrie 4.0-Phase, die bis heute anhält, ist die zunehmende Digitalisierung von Systemen und Prozessen – daher auch die Bezeichnung digitale Revolution. Industrie 4.0 hat enorme Auswirkungen auf die Produktions- und Arbeitswelt im globalen Zeitalter. In den Fabriken der Zukunft verschmelzen IT und Fertigungstechnik. Die digitale Vernetzung macht es möglich, Maschinen aufeinander abzustimmen, Zeit und Ressourcen einzusparen und hochindividualisierte Produkte auch in geringen Stückzahlen wirtschaftlich effizient herzustellen. Häufig fällt in diesem Zusammenhang auch der Begriff des Internet of Things.

Dieser Begriff bezeichnet ein Netzwerk von physischen Objekten (things), die Software, Sensoren oder weitere Technologien beinhalten, über die sie mit anderen gleichartigen Objekten über das Internet Daten austauschen können. Durch eine Kennzeichnung von Gebrauchsgegenständen durch Strich- oder QR-Codes und eine intelligente Vernetzung von Maschinen untereinander, erhält die Digitalisierung auch in klassischen handwerklichen Industriezweigen Einzug. So werden beispielsweise Regale automatisch aufgefüllt, sobald genügend Platz vorhanden ist, oder Temperaturen in Büroräumen per App automatisch reguliert. Künstliche Intelligenz stellt eine der treibenden Kräfte der vierten industriellen Revolution dar. Maschinelles Lernen ist ein mächtiges Werkzeug, um aus den teils riesigen Datenmengen, die häufig als Nebenprodukt der Digitalisierung resultieren, neue Geschäftsmodelle zu entwickeln und bestehende Prozesse zu optimieren.

Meilensteine in der Geschichte der KI:

Von damals bis heute

1936: Turing und seine Maschine

Der britische Mathematiker Alan Turing beweist durch seine Theorien, dass eine Rechenmaschine – eine sogenannte „Turingmaschine“ – in der Lage wäre, kognitive Prozesse auszuführen, sofern diese sich in mehrere Einzelschritte zerlegen und durch einen Algorithmus darstellen lassen. Damit legt er den Grundstein für das, was wir heute unter Künstlicher Intelligenz verstehen. Turing gilt heute als einer der einflussreichsten Theoretiker der frühen Computerentwicklung und Informatik und schuf einen großen Teil der theoretischen Grundlagen für die moderne Informations- und Computertechnologie.

1956: Begriffliche Geburtsstunde

Im Sommer 1956 treffen sich einige der renommiertesten Wissenschaftlerinnen und Wissenschaftler verschiedenster Disziplinen zu einer Konferenz am Dartmouth College im US-Bundesstaat New Hampshire. Dieses Treffen gilt als Geburtsstunde des Begriffs ‚Künstliche Intelligenz‘. Im Antrag der Konferenz, der den Titel „Dartmouth Summer Research Project on Artificial Intelligence“ trägt, wurde der Begriff von John McCarthy erstmals eingeführt und fand von dort an konsistent Verwendung in wissenschaftlichen Kreisen. Während der Konferenz wird mit dem „Logic Theorist“ – ein Computerprogramm, welches menschliches mathematisches Denken simuliert, das erste KI-Programm der Welt geschrieben. Das Programm war in der Lage, mehrere Dutzend mathematische Theoreme zu beweisen – eine Fähigkeit, die bisher ausschließlich in menschlicher Hand lag.

1966: ELIZA – KI beginnt zu kommunizieren

Der deutsch-amerikanische Informatiker Joseph Weizenbaum vom Massachusetts Institute of Technology erfindet mit einem relativ simplen Verfahren das Programm ELIZA, welches über Skripte verschiedene Gesprächspartner simulieren kann. Bekannt wurde ELIZA insbesondere durch die Simulation des Dialogs eines Psychotherapeuten mit einem Patienten in natürlicher Sprache. Die Wirkung des Programms war überwältigend. Weizenbaum war selbst überrascht, dass man auf relativ einfache Weise Menschen die Illusion eines menschlichen Gegenübers vermitteln kann. ELIZA war eines der ersten Programme, die sich dem Turing-Test stellte. Da das Programm auf Skripten basierte, konnte es relativ schnell überlistet werden, sobald im Gesprächsverlauf zu große Abweichungen auftraten. Jedoch spricht man auch heute noch bei der oftmals unbewussten Tendenz, Verhalten von Computern zu vermenschlichen, vom ELIZA-Effekt.

1972: KI als Experte

Mit „MYCIN“ findet Künstliche Intelligenz den Weg in die Praxis: Das von Ted Shortliffe an der Stanford University entwickelte Expertensystem wird zur Unterstützung bei Diagnose- und Therapieentscheidungen für Blutinfektionskrankheiten und Meningitis eingesetzt. Eine Evaluation hat ergeben, dass die Entscheidungen so gut sind wie die eines Experten in dem betreffenden Bereich und besser als die eines Nicht-Experten.

Grundsätzlich sind Expertensysteme Computerprogramme, die das Wissen eines bestimmten Fachgebietes durch Formeln, Regeln und eine Wissensdatenbank bündeln. Man erhoffte sich vielfältige industrielle Anwendungen und eine Ablösung „eintöniger“ menschlicher Tätigkeit durch KI-gesteuerte Systeme.

1986: NETtalk – Die sprechende KI

Durch die Eingabe von Beispielsätzen und Phonemketten bringen Terrence J. Sejnowski und Charles Rosenberg ihrem Programm „NETtalk“ erstmals das Sprechen bei. „NETtalk“ kann Wörter lesen und korrekt aussprechen sowie das Gelernte auf unbekannte Wörter anwenden. Damit ist es eines der frühen künstlichen neuronalen Netze. Künstliche neuronale Netze sind Programme, die mit großen Datensätzen gefüttert werden und darauf aufbauend eigene Schlüsse ziehen können. In Aufbau und Funktion ähneln sie somit dem menschlichen Gehirn.

1997: KI als Spielgegner

Deep Blue ist ein vom IBM-Forscher Giorgio Coraluppi und weiteren IBM-Kollegen entwickelter Schachcomputer. Er bezwang 1997 den amtierenden Schachweltmeister Garry Kasparov in einem Wettkampf aus sechs Partien unter Turnierbedingungen. Dies gilt als historischer Erfolg der Maschinen in einem Bereich, der bislang vom Menschen dominiert wurde. Kritiker werfen jedoch ein, dass „Deep Blue“ nicht durch kognitive Intelligenz, sondern nur durch das Berechnen aller denkbaren Züge gewonnen habe. IBM räumte selbst ein, dass es sich bei Deep Blue nicht wirklich um ein lernendes System handelt:

Deep Blue ist in seiner heutigen Form kein ‘lernendes System’. Es ist daher nicht in der Lage, Künstliche Intelligenz zu nutzen, um entweder von seinem Gegner zu lernen oder über die aktuelle Position auf dem Schachbrett zu ‘denken’. […] Alle Änderungen an der Art und Weise, wie Deep Blue Schach spielt, müssen vom Entwicklungsteam zwischen den Partien vorgenommen werden. Garry Kasparov kann seine Spielweise jederzeit vor, während und/oder nach jeder Partie ändern.” (Sinngemäße Übersetzung)

Gegenwart: KI-Entwicklungen in verschiedenen Bereichen

Rasche Entwicklungssprünge bei der Hard- und Software bahnen Künstlicher Intelligenz den Weg in das tägliche Leben. Leistungsstarke Prozessoren und Grafikkarten in Computern, Smartphones und Tablets ermöglichen es Menschen, auf KI-Programme zuzugreifen. Insbesondere Sprachassistenten erfreuen sich großer Beliebtheit: Apples „Siri“ kam 2011 auf den Markt, 2014 stellte Microsoft die Software „Cortana“ vor und Amazon präsentierte 2015 Amazon Echo mit dem Sprachdienst „Alexa“. Technologisch basieren diese Assistenten auf einem Zusammenspiel verschiedener Technologien wie Spracherkennung und -verarbeitung, maschinellem Lernen sowie Zugriff auf Datenbanken und Schnittstellen zu anderen Anwendungen, um angefragte Informationen abzurufen. Zweck dieser Assistenten ist es, die Anfragen und Bedürfnisse der Nutzer:innen zu verstehen und diesen durch passende Antworten zu helfen.

Und auch in der Gegenwart wird KI als Spielgegner eingesetzt: Im Jahr 2016 hat das KI-System AlphaGo (von Google DeepMind) einen der besten menschlichen Spieler im Go besiegt. Bei Go handelt es sich aufgrund seiner Komplexität und vieler Möglichkeiten an Zügen um eines der schwierigsten existierenden Spiele überhaupt. Deswegen wird dieser Sieg als ein weiterer großer Meilenstein in der Entwicklung von KI-Systemen gesehen. AlphaGo nutzt eine Kombination aus verschiedenen Herangehensweisen, darunter Deep Learning. Das Deep Learning-Modell von AlphaGo wurde mit einer großen Menge an Daten von Go-Spielpartien trainiert, um Muster und Strategien zu erkennen. Weiterhin wurde die KI trainiert, eine passende Spielstrategie zu wählen, indem sehr viele verschiedene möglicher Züge durchprobiert und bewertet wurden, um die am besten geeignete zu finden. Außerdem hat AlphaGo Zugriff auf menschliche Bewertungen, mit Hilfe derer sie lernt, wie sie Züge auswählen sollte. Das System verwendet auch “Reinforcement Learning”, um sich durch Spiele gegen sich selbst zu verbessern. Bereits für solche KI-Systeme sind massive Ressourcen nötig, wie z.B. leistungsstarke Computer und Datenzentren.

Ein weiterer Durchbruch zum spezifischen Einsatz von KI ist im Bereich der Biotechnologie und Medizin zu verzeichnen. Hier ist es gelungen, das KI-Systeme die 3D-Struktur von Proteinen entschlüsseln und vorhersagen können (AlphaFold 2). Dieser Fortschritt ist ein wichtiger Schritt in der Erforschung von Krankheiten, da die 3D-Struktur von Proteinen ein wichtiger Faktor bei der Wirkungsweise von Medikamenten ist.

Neben diesen spezifischeren Anwendungsgebieten, gibt es auch Systeme, die zwar spezifische Aufgaben erledigen, aber dafür thematisch breiter anwendbar sind. Aktuelle weitere Entwicklungen führen zu wichtigen Fortschritten im Bereich der generativen KI (Generative Adversarial Networks), wie z.B. zur Neuschaffung von Bildern, Musik und Texten ohne menschlichen Eingriff, oder auch im Bereich der Übersetzung von Sprachen (z.B. Google’s Neural Machine Translation).

Resumé

Trotz jahrzehntelanger Forschung und rascher technischer Entwicklungen steckt die Geschichte der Künstlichen Intelligenz relativ betrachtet noch in den Kinderschuhen.

Bis heute ist die Geschichte der KI stets geprägt von einem Auf und Ab an Euphorie und Desillusion. Aus der ersten Entwicklungsphase erwuchs die Erkenntnis, dass ein universelles Herangehen zu komplex ist, um erfolgreiche Anwendungen zu entwickeln. So setzte eine gewisse Spezialisierung ein, wie die Entwicklung erster Expertensysteme. Trotz der Ernüchterung, nicht alle Probleme universell lösen zu können, folgten weitere Erfolgsmeldungen, nun aber spezialisiert auf bestimmte Anwendungsgebiete. Durch die Erfahrungen der Jahre zuvor war klar, dass man problemspezifisch vorgehen muss. Die Leistungskraft einer Problemlösung hängt eher vom Problemwissen als von den allgemeinen Problemlösungstechniken ab. Gegenwärtig schwingt das Pendel zwischen Ernüchterung und Euphorie wieder in Richtung Euphorie – Maschinen besiegen Menschen in Spielen, werten Daten effizienter aus oder fahren (teil)automatisiert auf der Straße. Smarte Systeme sind im Trend und gelten als relevanter Erfolgsfaktor für Unternehmen aus unterschiedlichsten Branchen.

Damit Künstliche Intelligenz in sensiblen Lebensbereichen und Arbeitsumgebungen eingesetzt werden kann, müssen die Systeme zuverlässiger, sicherer und vertrauenswürdiger werden. Insbesondere in den letzten Jahren werden zunehmend transparente KI-Systeme gefordert. Abseits von arbeitsrechtlichen Verordnungen gibt es das Bedürfnis, über die Funktionsweise von Systemen aufgeklärt zu werden und diese zu verstehen.